ChatGPT pone en pie de guerra a las profesiones cualificadas

Profesionales, artistas, compañías discográficas o medios de comunicación se rebelan contra una tecnología que utiliza su trabajo sin su consentimiento y sin compensación

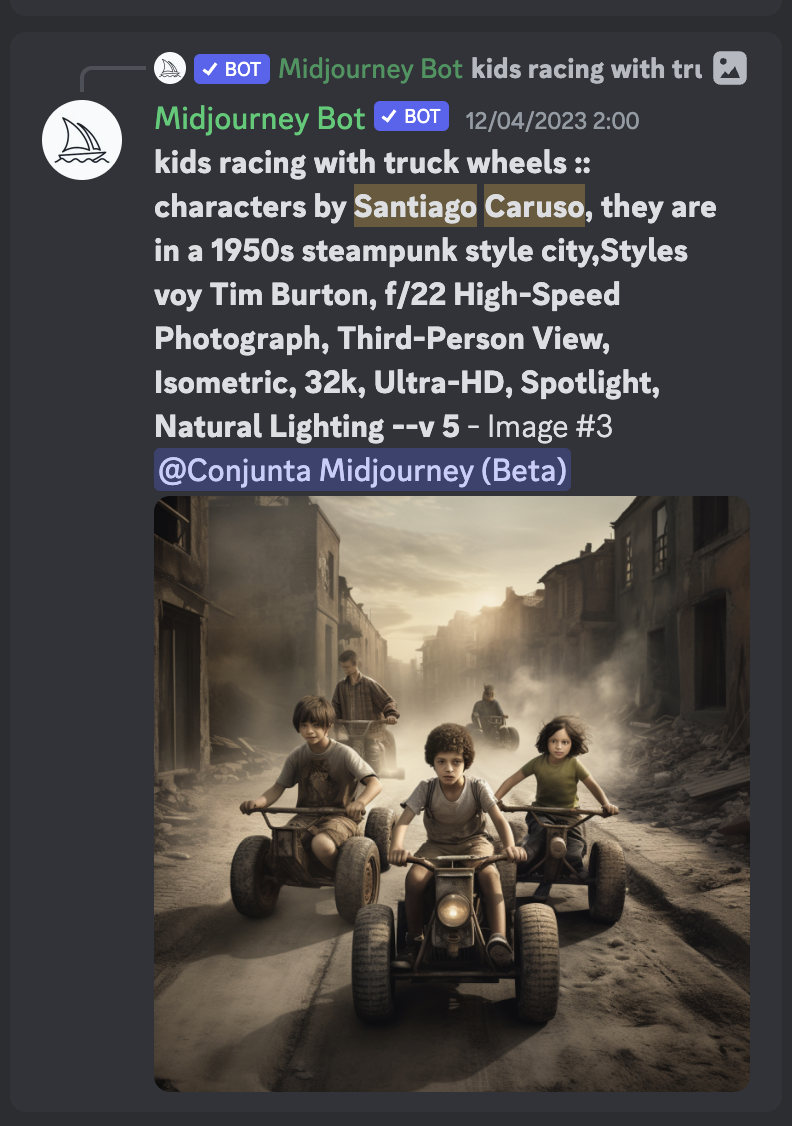

Santiago Caruso es un artista e ilustrador argentino dedicado a lo fantástico. Su obra ha sido presentada en galerías y museos en países como Estados Unidos, Reino Unido o España. Hace unos meses, le salió un imitador que no solo crea obras muy similares a las suyas, sino que a menudo se hace pasar por él. Se llama Midjourney, y es una herramienta de inteligencia artificial (IA) generativa.

Caruso es uno de los miles, probablemente millones de personas afectadas por la irrupción de los grandes modelos de lenguaje natural (LLM). Es un tipo de IA que genera todo tipo de contenido textual y audiovisual a partir de instrucciones de texto. Puede desde programar hasta componer música, diseñar, pintar cuadros, locutar o escribir artículos científicos falsos, entre muchas tareas.

Todas estas y otras actividades son propias de profesiones cualificadas que se ven amenazadas por la automatización. La empresa Open AI (creadora de ChatGPT y Dall-E) calcula en un estudio que alrededor de un 80% de la fuerza laboral estadounidense verá su trabajo afectado por los LLM.

Las personas trabajadoras de cuello blanco pueden ser reemplazadas por tecnologías que se entrenan con su trabajo sin su consentimiento y sin compensarles a cambio. De ahí que diversos colectivos se hayan puesto en pie de guerra. Uno de ellos, al que pertenece Caruso, es Arte es Ética, y está integrado por profesionales independientes y por asociaciones gremiales del mundo hispanohablante.

En pie de guerra

Arte es Ética ha lanzado un manifiesto para comprender y regular las nuevas tecnologías En él, denuncian la expropiación de un inmenso acervo artístico -millones de imágenes y contenido de internet- a través del desarrollo del modelo de código abierto Stable Diffusion que explotan herramientas como Midjourney o Dall-E 2. Apuntan, por ello, a su “carácter delictivo”.

Lo más importante para Caruso es que su obra no sea usada para alimentar la tecnología. Sin embargo, esto ya no es posible con los modelos existentes. “Si son ilegales, construidos de modo espurio y contra la voluntad de miles de personas, que los destruyan”. Para quienes acepten que su obra sea usada para entrenar los LLM, sugiere un pago cuantioso “ya que no podrán volver a ejercer su profesión”.

Desde Arte es Ética, reclaman “volver a un estado de legalidad”; que no se legitime ni se normalice una nueva industria “de carácter parasitario”; que se refuerce la regulación sobre recopilación y rastreo de datos “para evitar que se desarrollen nuevos modelos de IA que compitan de manera desleal”; y “una serie de reglas éticas que garanticen la sana continuidad del oficio creativo”.

La IA, a juicio

Dicha continuidad está, en efecto, en duda. “Muchas profesiones tienen probablemente los días contados”, afirma Alejandro Puerto, registrador de la Propiedad Intelectual de la Comunidad de Madrid. Puerto dice conocer varias empresas que han dejado de contratar a ilustradores para ciertos trabajos: ahora se los hace Midjourney.

El registrador ha recibido hasta el momento dos solicitudes de registro de obras que usaban herramientas generativas. Puede que haya más que no lo especifiquen, y eso es un problema, porque no tiene forma de saberlo. Una de esas obras es un libro sobre cómo crear imágenes empleando distintos programas de IA. La otra es una novela cuyo contenido ha sido producido, al menos en parte, por ChatGPT, en la que se acredita como autores al solicitante y a ChatGPT. En ambos casos, su resolución ha sido la misma: inscripción denegada.

El derecho de autor solo funciona cuando lo crea una persona física, pero no si lo genera una máquina en base a sus instrucciones o prompts. Los dictámenes de Puerto señalan que las obras presentadas no cumplen con el requisito de la creación humana ni de la originalidad; y que el hecho de que el contenido sea resultado de las órdenes específicas del solicitante no es suficiente para considerar que es su autor.

Además, en el caso de la novela, la forma en que se han fundido las aportaciones humanas con las con las generadas a través de la IA no permite identificar de forma adecuada cuáles serían las creaciones protegibles dentro del conjunto del resultado final. Puerto asegura que el escenario “cambia totalmente con estas herramientas” y que es necesario que las autoridades tomen una decisión clara al respecto.

Demandas en sentido opuesto

Por el momento, a los autores de este tipo de obra a quienes se les deniegue la inscripción, solo les queda ir a juicio. En los tribunales hay cada vez más casos, pero en sentido opuesto: demandas contra sistemas LLM que se han nutrido de imágenes, textos, obras audiovisuales, etc. para generar nuevos productos. Como explica el experto en propiedad intelectual y derecho digital Juan Antonio Orgaz, asesor de la Ventanilla Única Digital, estas parten tanto de autores como de organizaciones.

Orgaz -también profesor de la Universidad Complutense de Madrid- destaca la demanda contra Midjourney, Stability AI y a DeviantArt en nombre de las diseñadoras Karla Ortiz, Sarah Andersen y Kelly McKernan en Estados Unidos, y la del repositorio Getty Images contra Stability AI en el Tribunal Superior de Justicia de Londres.

Los programadores también han iniciado procedimientos. Los abogados que llevan el caso de Karla y sus compañeras habían presentado unos meses antes -en noviembre de 2022- una demanda colectiva en un tribunal federal de EEUU en nombre de millones de usuarios de GitHub. Esta, aún en proceso, cuestiona la legalidad de GitHub Copilot, un producto de Microsoft que ayuda a desarrollar programas informáticos. La demanda afirma que la empresa ha violado los derechos legales de una gran cantidad de creadores que publicaron su trabajo bajo ciertas licencias de código abierto en GitHub.

Medios de comunicación y discográficas

Los medios de comunicación son otro de los grandes afectados, que reclaman que las herramientas de IA no utilicen sus creaciones, imágenes, voces, etc. en la generación de nuevos productos. “Los principales medios de comunicación americanos han criticado abiertamente a OpenAI por utilizar los artículos escritos por sus periodistas y colaboradores para entrenar a ChatGPT sin mediar autorización previa y, por tanto, sin compensación alguna”, comenta Orgaz.

“De igual manera, las principales compañías discográficas del mundo están prohibiendo el uso de los fonogramas grabados por los artistas con los que tienen contrato para que las herramientas de IA no puedan utilizarlos, tras el falso dúo entre Drake y The Weekend”, añade. Se refiere a una canción generada artificialmente por un usuario de una conocida red social que se hizo viral por lo bien que da el pego: parece que de verdad era una obra de Drake y The Weekend, y además -dice- suena bien. Otros músicos como Rosalía tampoco se han librado.

¿Aumentados o alienados?

Pintura, ilustración, fotografía, animación, locución, doblaje, programación, escritura, periodismo, moda… Pocos sectores se libran del alcance de la IA generativa. ¿Qué será de estas profesiones? ¿Verán mejoradas sus condiciones gracias al uso de dichas herramientas, como arguyen algunos, o por el contrario quienes las ejerzan quedarán condenadas a la extinción?

Caruso se alinea claramente con lo segundo. Otros expertos creen que el trabajo se reconfigurará, integrando la IA, y que esos cambios requerirán de una recualificación. Así lo ve Albert Cañigueral, autor de El trabajo ya no es lo que era. El experto alude como propuesta válida al marco conceptualizado por Arun Sundararajan, catedrático de emprendimiento de la Universidad de Nueva York: primero los humanos aumentan a las máquinas, luego -valiéndose de ellas- se reinventan los procesos de trabajo, y finalmente serían estas estas quienes aumenten a los humanos.

Ya parece estar haciéndolo en ciertos ámbitos. Concretamente, en el de la atención al cliente. Un estudio firmado por el profesor emérito de la Universidad de Stanford Erik Brynjolfsson muestra que los chatbots de IA generativa pueden hacer que empleados con bajas cualificaciones dedicados al servicio al cliente sean hasta un 14% más productivos. A los más cualificados les resulta, en todo caso, una distracción.

Caruso denuncia que en campos como el de la ilustración o el diseño sucede algo más extremo: personas sin ningún tipo de destreza o experiencia, que a lo sumo tienen unas nociones de Photoshop, pueden imitar su trabajo con una precisión aterradora. Personas sin oficio podrán tal vez obtener fraguarse una carrera artística o al menos una nueva forma de ingresos, pero será -dice- aún más precaria de lo que ya son estas profesiones. “Los prompters ofrecen abiertamente sus servicios a muy bajo coste para obtener clientes, con el argumento del notable ahorro de costes que obtendrán”, critica. Mientras tanto, los profesionales cualificados en estos sectores “nos quedaremos sin encargos”.

¿Puede ser peor?

Javier de la Cueva, abogado y profesor especializado en propiedad intelectual, tecnología e internet, no cree que haya mucho margen de empeoramiento para los artistas y creadores. “La autoría está totalmente precarizada. Si algo nos ha demostrado el modelo de propiedad intelectual existente es que es un sistema utilizado por una minoría para extraer el valor de las creaciones de los individuos”, señala. “En su mayor medida, las personas autoras no son los titulares de los derechos de explotación de sus obras sino que los han tenido que ceder por un plato de lentejas, y para muestra el periodismo”, añade.

Para Caruso esto no es excusa. Tampoco lo es para Sandra Wachter, catedrática de Tecnología y Regulación en Oxford Internet Institute (OII) de la Universidad de Oxford. “Que este no sea un problema nuevo no significa que no debamos hacer nada al respecto. ¿Acaso lo hemos solucionado?”, cuestiona. “Seguimos sin estar preparados para ello. Es difícil saber cuán disruptivo será el efecto de la IA generativa, pero la respuesta no es hacer nada, sino evaluar, de manera continua, cuál podría ser su impacto”, prosigue.

Wachter sostiene que el riesgo es que se dé la misma situación que durante la Revolución Industrial, cuando los granjeros fueron desplazados por las máquinas y tuvieron que mudarse a la ciudad y trabajar el doble de tiempo, en las fábricas, por la mitad de los ingresos. “Debemos anticiparnos antes de que la gente se quede sin trabajo y pensar en qué es aceptable y qué no. Que puedas automatizar algo que no significa que debas hacerlo. No todos los tipos de automatización son deseables”, afirma la experta del OII.

Ante el argumento de que la automatización permite a las personas trabajadoras afectadas dedicarse a tareas de valor añadido, pone el ejemplo de las cajeras y cajeros en supermercados. “Para los que no han sido reemplazados por máquinas, ¿ha mejorado la calidad de su trabajo? Todo lo que hacen ahora es supervisarlas y pulsar un botón si estas no reconocen un código. El trabajo se ha vuelto más aburrido y peor pagado, porque necesitas una menor cualificación para ello”, destaca.

Eso hace, además, que haya más personas que puedan competir para conseguir dicho trabajo, ya que es menos cualificado. “Esa competencia hace que bajen los salarios”, apunta Wachter. Apliquemos esto ahora al ejemplo que ponía Caruso con los ilustradores y diseñadores: sucede exactamente lo mismo.

Algo parecido sucede con la fuerza de trabajo necesaria para desarrollar las herramientas de IA generativa. La revista Time reveló que OpenAI pagó menos de 2 euros la hora a trabajadores kenianos para tratar de hacer que ChatGPT fuera menos tóxico. Estos se dedicaban a etiquetar ejemplos de violencia, odio, abuso sexual, etc., con muestras sacadas de los rincones más oscuros de internet.

Esta problemática la denunciaron la antropóloga Mary Gray y el experto en ciencia social computacional Siddharth Suri en su libro Ghost Work. How to Stop Silicon Valley from Building a New Global Underclass (2019). En su investigación, describen cómo detrás de las herramientas automatizadas se esconde una masa de trabajadores invisibles y precarizados.

Sobre la IA generativa en particular, Gray -investigadora en Microsoft Research- señala que los LLM continuarán requiriendo actualizaciones, localización y traducción. “Cuanto más integración de estos haya, más trabajo digital habrá para afinar y postprocesar estos modelos”, afirma. La experta cita el ejemplo de EPIC, el proveedor de registros médicos electrónicos más grande de EEUU, que ha anunciado sus planes para añadir LLM a su software para administrar la documentación clínica.

“Esto reducirá el tiempo que los médicos dedican a ingresar datos a mano o por voz, pero será necesario que haya más control de calidad para revisar los registros médicos electrónicos generativos creados por IA, e incluso para ayudar a integrar estos documentos con otros materiales”, explica Gray. Lo que más le preocupa es que, “si no hay una visión clara de cómo se deben aplicar los LLM en los entornos sociales, veremos un rápido desarrollo de una brecha de IA, no diferente de la brecha digital que aún persiste: más de un tercio de la población mundial no está conectada ni ha accedido nunca a Internet”.

Medidas de protección

La brecha de la IA se añade a la lista de efectos desencadenados con el lanzamiento de las herramientas generativas. Sus creadores dicen que estas se escapan a su control. “Si no puedes controlarla ni anticipar su riesgo, entonces no la liberes”, dice Wachter. “Es interesante cómo las empresas de tecnología se salen con la suya. En cualquier otra industria, eso sería impensable. Deberíamos pensar en las estructuras de responsabilidad tradicionales que obligan a rendir cuentas por lanzar productos dañinos o que puedan causar problemas”, sugiere.

Wachter asegura que es necesario al menos debatir sobre medidas como la Renta Básica Universal (RBU) y sobre la provisión de servicios básicos a trabajadores autónomos que se ganan la vida -o sobreviven- a base de contratos por tareas (los llamados minijobs). También -dice- necesitamos hablar sobre impuestos. “¿Por qué las organizaciones que ahorran dinero al no contratar humanos no deberían estar obligadas a pagar más tributos? No podemos hablar de distribución equitativa de la riqueza si no es así”, afirma.

La investigadora cree que se deberían recuperar los debates sobre las tasas a los robots, la RBU y las coberturas sociales que se abrieron con el boom de la gig economy, dado que este sigue siendo un problema no resuelto. También considera que debería existir alguna protección laboral que asegure que a una persona se le paga de manera justa si su salario se reduce a la mitad por haber sido parcialmente reemplazado por una máquina y necesita atender dos trabajos en lugar de uno para poder pagar las facturas.

“¿Es ese el progreso del que todos estamos hablando? ¿La utopía de la automatización profunda que nos prometen? Obviamente no”, asevera Wachter. “Todo lo que damos por sentado -un trabajo con buenas condiciones, capacidad para planificar más allá del día siguiente, cobertura sanitaria adecuada, una pensión, medidas de conciliación,etc.- desaparece en los trabajos temporales”, añade. “Debemos prepararnos para el peor de los escenarios”, concluye.

Un fondo para el sector creativo

Entre las propuestas de la plataforma Arte es Ética hay también varias en la línea con la cobertura de los trabajadores autónomos y los impuestos que propone Wachter. Sugieren también impulsar la creación de un fondo estatal para cubrir las necesidades más urgentes del sector creativo, destinado al desarrollo de proyectos artísticos y la creación de empleos que incluyan mano de obra e inteligencia humana.

En cuanto a la explotación del trabajo creativo, Arte es Ética exige que sea necesario el consentimiento previo para el uso de cualquier contenido para el entrenamiento de plataformas generativas; que estas anulen para sus usuarios la funcionalidad de buscar nombres propios de quienes no hayan aceptado formar parte del set de datos ni de la generación de derivados automatizados de su obra; y que las imágenes producidas con estos modelos lleven una marca de agua de la plataforma que la generó, además de una ‘firma digital’, entre otras cosas. Apelan a la Organización Mundial de la Propiedad Intelectual (OMPI) para solicitar su urgente intervención y arbitraje, y a denegar el registro de obras generadas por IA hasta contar con información fehaciente de cuál es el grado de proceso humano implicado en el resultado final.

Paso tímido de Bruselas

Como señala Puerto, ni España ni la Unión Europea se han pronunciado aún al respecto. Sí lo ha hecho parcialmente esta última sobre el asunto del copyright de las plataformas. La Comisión Europea ha propuesto incluir en la Ley de Inteligencia Artificial la obligación para las empresas de divulgar cualquier material protegido por derechos de autor utilizado para desarrollar los sistemas de IA generativa.

Es una medida que no satisfará a muchos, como la diputada Svenja Hahn reconoce. "En contra de los deseos conservadores de una mayor vigilancia y de las fantasías izquierdistas de una regulación excesiva, el parlamento encontró un compromiso sólido para regular la IA de manera proporcional, proteger los derechos de los ciudadanos, fomentar la innovación e impulsar la economía", aseguró el pasado 28 de abril, según recoge Reuters.

“La producción masiva de contenidos generados por IA probablemente va a suponer una profunda crisis en lo que significa la cultura de un territorio y también una revolución en las industrias creativas y en el propio desarrollo de los sistemas políticos en los que vivimos. Propongo que aprovechemos lo vivido en tiempo de la Revolución Industrial y que evitemos pasar a los ciudadanos del Siglo XXI las grandes penurias vividas por los trabajadores de entonces”, apunta Ortiz.

El asunto regulatorio es espinoso y complejo, pero eso no ha de ser excusa para inacción. En un momento en el que la industria tecnológica parece seguir los pasos de la industria de la moda, copiando sus peores prácticas en explotación laboral, es necesario reforzar los marcos internacionales para garantizar unas condiciones de trabajo justas. Trabajar en el análisis y las medidas de prevención y protección ante externalidades negativas para los trabajadores es imperativo en un contexto de funcionamiento oligopólico de los gigantes tecnológicos en el que las asimetrías de poder siguen aumentando.